L’édition 2025 nous a proposé un mélange dosé avec soin : gros projets de studios de renom, tables rondes prospectives, mais aussi conférences sur des projets plus confidentiels. Les sujets allaient des derniers blockbusters à l’avenir de l’industrie, en passant par des projets de recherche ou des conseils pour améliorer son portfolio. Sans oublier une bonne dose de nostalgie.

K-Pop et Dragons

Plongeons directement dans le vif du sujet, et un des points phares de la VIEW Conference : les présentations sur les gros projets de l’année écoulée et des mois à venir.

La conférence sur le remake live de Dragons, face à une salle comble, restera un moment fort de cette édition : l’équipe du film nous a présenté les enjeux majeurs du film. Les dragons ne pouvaient pas être identiques à ceux du film d’animation, car un côté trop cartoon n’aurait pas donné un rendu crédible face aux vrais acteurs. Trois mois de tests n’ont pas été de trop pour adapter les designs. Même Krokmou a eu droit à une refonte, l’objectif étant qu’il soit perçu comme un animal et non un personnage. Bien plus grand dans le film live que la version animée, il est doté d’yeux de chats, mais avec beaucoup de relief dans l’iris, comme des yeux humains.

Nous avons aussi eu droit à des images de coulisses, et nous avons particulièrement apprécié de découvrir la machinerie utilisée pour le tournage : des robots conçus pour l’occasion et sur lesquels les acteurs étaient assis. De quoi obtenir un meilleur jeu à l’écran.

La présentation sur K-Pop Demon Hunters fut un autre moment fort. Le duo en charge de la réalisation nous a dévoilé de nombreux concepts artworks et éléments de coulisses. Surprise : la K-Pop est en fait un des derniers éléments arrivés dans le script. Et constituait un risque, puisqu’à l’époque la K-Pop n’était encore qu’une mode en occident. On ignorait sur le sillage du groupe BTS serait peuplé d’autres succès ou si la K-Pop allait sombrer dans l’oubli.

Dans un autre panel sur l’avenir du secteur, Maggie Kang et Chris Appelhans sont aussi revenus sur l’engouement sans précédent autour du film, soulignant la croissance finalement assez organique de l’audience, dans un monde où les algorithmes règnent pourtant en maîtres sur les réseaux. Le film a d’abord touché sa cible principale, mais les fans ont créé des contenus autour de l’œuvre, notamment sur Tiktok, ce qui a décuplé la visibilité du long-métrage et permis de toucher un public bien plus large. La sortie en streaming a sans doute été un facteur capital : entre entendre parler du film et le lancer sur Netflix, quelques clics suffisent.

Gaussian Splatting : une technologie enfin mature ?

Plusieurs présentations sont revenues sur l’usage du gaussian splatting, une technologie liée à la capture 3D d’éléments réels qui, bien que jeune, connaît un gros essor. Pour faire simple, on peut la présenter comme une sorte de nuage de points survitaminé, les points dans l’espace 3D étant remplacés par des formes 3D colorées aux contours flous (les gaussiennes du nom).

Sans trop s’attarder sur la techniques, on retiendra surtout que par rapport aux bons vieux meshes de polygones créés par des techniques comme la photogrammétrie, cette approche s’avère plus qualitative pour représenter les scènes avec des détails fins, comme les poils ou les feuilles d’arbres.

Mieux encore, il est aussi possible aussi d’avoir une apparence visuelle changeante selon le point de vue, et donc de représenter des effets optiques complexes : reflets, surfaces anisotropes, etc. A la clé, un réalisme accru. Autrement dit, on dépasse de nombreuses limites de la photogrammétrie classique.

De multiples conférences ont permis de mettre en lumière les usages possibles. Par exemple, sur Jurassic World, durant les repérages, l’équipe VFX a filmé différents décors réels au smartphone et avec des caméras 360° grand public. Le studio Proof a ensuite utilisé ces données pour créer des scènes en gaussian splatting, et les a injectées dans un système de caméra virtuelle.

Le réalisateur Gareth Edwards a alors pu se promener virtuellement dans ces scènes, préparer ses caméras, réfléchir à la mise en scène. Et gagner un temps précieux lors du tournage.

Cet exemple est d’autant plus intéressant que la capture a impliqué du matériel grand public.

Autre exemple emblématique : le dernier Superman. Le superviseur VFX Stéphane Nazé nous a expliqué que l’hologramme des parents de Superman a été conçu en gaussian splatting. Un choix fait pour de multiples raisons : le réalisateur tenait par exemple à avoir un rendu très réaliste, et de la projection ou de la vidéo 4D n’auraient pas suffi.

L’usage de gaussian splatting a en outre permis de découper facilement la séquence, d’ajouter un effet de glitch sous Houdini, d’ajuster facilement la caméra après la capture. Le tout, en gardant la vision artistique du réalisateur, et avec des détails fins préservés.

Ces deux exemples montrent des usages pertinents, que ce soit à l’écran ou dans le processus créatif.

Ils ont cependant aussi mis en valeur des pipelines encore assez peu éprouvés par rapport à du scan classique : la technologie est bonne mais pas totalement mature, et les évolutions sont rapides.

Les studios devront donc suivre avec attention les changements techniques, et ne pas hésiter à tester différents outils et workflows.

Reste que l’approche est promise à un bel avenir, y compris sur des petits projets, comme l’expliquait Eloi Champagne de l’ONF (au Canada) en présentant ses expérimentations.

RenderMan : une petite révolution pour les studios, et les écoles !

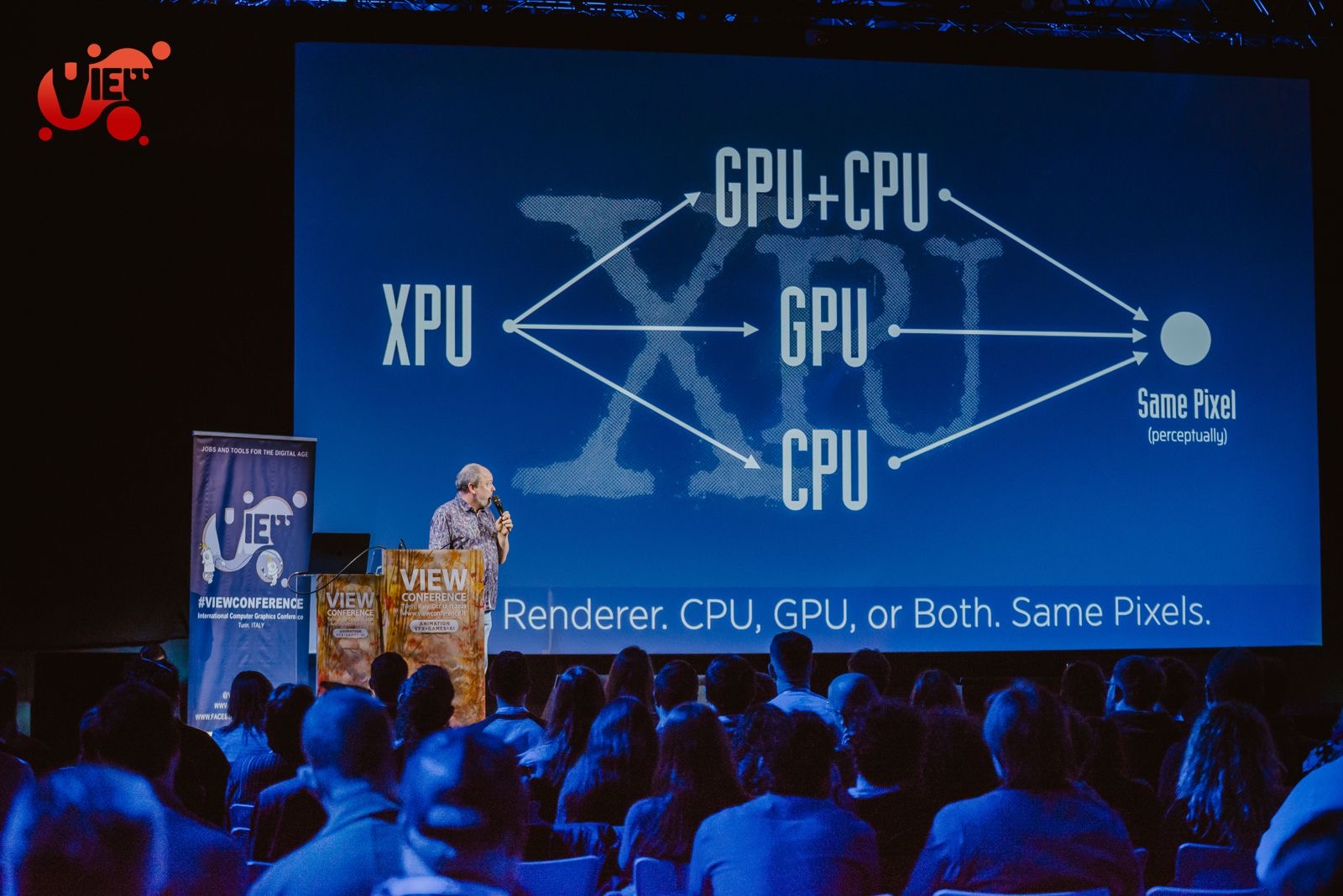

Autre avancée technique majeure : l’arrivée de la nouvelle version de RenderMan, le moteur de rendu de Pixar. Dylan Sisson nous a présenté les améliorations apportées, le point majeur étant la finalisation de XPU, désormais utilisable en production. Cette architecture de rendu permet de rendre les images à la fois sur CPU et GPU, et gère même les serveurs GPU. Bien évidemment, l’image reste la même quel que soit le matériel.

L’intérêt ? Des temps de rendu qui baissent de façon drastique, et il devient possible de mieux utiliser le matériel dont disposent artistes et studios. Ce constat s’applique aussi aux écoles : à l’ESMA, qui utilise RenderMan pour une bonne partie de ses films de fin d’études, les élèves pourront s’appuyer sur ces améliorations. De quoi finaliser des scènes plus rapidement, ou pousser davantage encore leur complexité.

Evidemment, Pixar ne se contente pas de faire des annonces, et joint le geste à la parole : le prochain Toy Story 5 utilise XPU.

L’IA : l’industrie se cherche encore

Autre sujet inévitable, celui de l’IA. L’IA « classique », comme le deep learning, ne fait pas débat : c’est plutôt l’IA générative qui pose question. Plusieurs conférences l’ont évoquée, avec des points de vue parfois diamétralement opposés : si du côté des directions de studios, c’est plutôt l’enthousiasme ou la résignation qui domine, d’autres voix craignaient l’impact sur l’industrie de l’image mais aussi sur nos modes de consommation des contenus animés (quel impact d’une déferlante encore plus grande de contenu ?). D’autres encore y voyaient un faux problème, considérant que l’IA ne pourrait jamais arriver au niveau de l’humain en matière de création, et qu’il y aurait toujours des plans à corriger.

Le studio de Phil Tippett, lui, a abordé le sujet sur un angle bien spécifique : l’équipe expérimente avec l’IA générative, mais avec des données créées en interne et en conservant un rendu qui évoque la stop-motion. L’idée est donc de contourner les questions de copyright en maîtrisant toute la chaîne, et sans perdre l’âme du studio.

En écoutant l’équipe, il était clair qu’elle considérait qu’attendre était le pire des choix. Il faut dire que le passé a un impact clair sur les décisions actuelles : en 1993, Tippett avait vu l’arrivée des effets numériques faire s’effondrer la stop-motion, et les dinosaures de Jurassic Park qui devaient être réalisés avec des marionnettes physiques ont finalement été portés à l’écran en animatroniques, mais aussi et surtout en pixels numériques. La légende des effets visuels est bien décidée à ne pas se laisser distancer.

Et ce, même si l’IA reste encore incontrôlable et imprévisible : « Nous ne prétendons pas savoir où nous allons », explique l’équipe, avant d’ajouter qu’il s’agit d’essais, de work in progress. Et Phil Tippett de conclure : « C’est comme un mauvais film de SF, l’IA est un peu comme le feu, elle changera tout. Reste à voir si elle nous tiendra chaud ou fera tout brûler. »

Une vision incertaine de l’avenir que l’on retrouvait dans d’autres panels. Dans une conférence centrée sur l’avenir de la création, une voix a dénoncé le pillage des œuvres sans compensation pour entraîner les IA génératives, tandis qu’un autre membre du panel voyait l’IA comme la caméra des smartphones : par rapport à il y a 20 ans, nous avons tous en main de quoi faire des films, la création de contenus a explosé, mais l’écrasante majorité n’est pas vue.

Dans une autre table ronde, un studio expliquait que ses clients refusaient majoritairement l’IA au vu des risques (juridiques notamment), tandis qu’un second expliquait s’en servir régulièrement. Là encore, selon les domaines et clients, les usages ne sont pas, pour le moment, harmonisés.

Chez Targo, société française spécialisée dans la XR et les documentaires, l’IA est vue comme un outil, mais l’équipe garde une certaine prudence. Leur choix : l’utiliser, par exemple pour donner vie à une photo ancienne ou créer des textures, mais préciser clairement au spectateur que l’IA est utilisée. Par exemple en l’indiquant au générique ou en laissant visible la photo d’origine utilisée comme base.

Enfin, la conférence qui réunissait des dirigeantes et dirigeants de studios a été moins mitigée que d’autres interventions, la plupart étant soit favorables à l’IA générative, soit partant du principe que son essor était impossible à stopper. On aurait néanmoins aimé ici un peu plus de franchise sur l’impact à attendre : face à une personne dans l’audience qui s’interrogeait sur le sort de son studio (spécialisé dans la rotoscopie et donc susceptible d’être remplacé par l’IA), les réponses nous ont semblé botter en touche.

Quoiqu’il en soit, et en prenant un peu de recul, on appréciera le fait qu’à l’échelle de l’événement dans son ensemble, les points de vue étaient assez variés, de l’adoption enthousiaste au rejet franc et à la critique, là où de nombreuses conférences récentes débouchaient sur des points de vue timides, beaucoup n’osant pas prendre clairement parti.

Emotion et Nostalgie

Terminons sur un regard vers le passé. Nous avons beaucoup apprécié la présentation du vétéran des effets pratiques Ian Hunter. Il nous a montré des photos de coulisses de films sur lesquels il a travaillé au cours de sa carrière : Une sublime maquette de vaisseau pour Total Recall, le pétrolier de Waterworld, une maquette de bombardier pour le thriller Broken Arrow, de somptueux décors miniatures pour Inception…

Le tout ponctué d’anecdotes, comme la présence d’une canette de Coca-Cola sur un des décors de Total Recall. Il n’a pas manqué d’évoquer les progrès techniques qui ont permis aux équipes d’effets pratiques de gagner du temps et de faire des économies ont toujours remonté aux oreilles des producteurs, qui n’ont pas manqué d’adapter leurs exigences en conséquence. Peut-être une leçon à garder en tête sur le sujet de l’IA générative, d’ailleurs, qui si elle permet de baisser les coûts de fabrication, se répercutera aussi sur les budgets globaux.

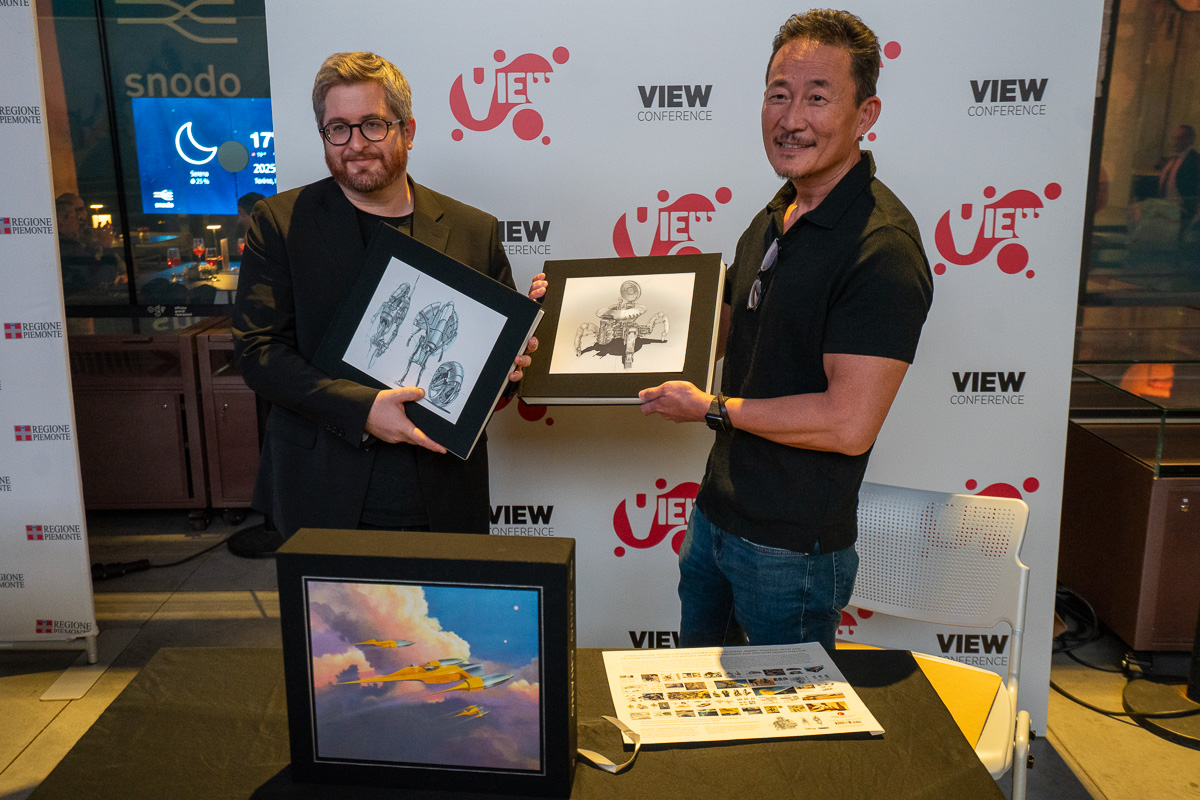

Nostalgie toujours avec Alexandre Poncet, qui nous a présenté des extraits du futur documentaire Walking With Animators. Celui-ci est moins un film historique qu’une présentation en 2h environ de l’univers de l’animation, ses techniques, et la vision d’artistes variés. Alexandre Poncet nous a aussi présenté un double livre massif sur Doug Chiang, créé avec l’aide de ce dernier. Toute une carrière et des centaines de photos, sur 800 pages. Un travail titanesque. Deux projets menés avec son complice Gilles Penso, mais aussi d’autres soutiens, comme Eugénie Poncet pour la production du film.

Deux projets qui rappellent l’importance de ne pas oublier le passé, et de garder une trace des projets : les archives constituent un trésor à préserver soigneusement, et on ne peut qu’inviter studios et artistes à ne pas l’oublier.

Une VIEW Conference riche, une industrie en transition

Vous l’aurez compris, la VIEW Conference est un évènement assez diversifié, qui mérite le détour. Les temps forts étaient nombreux, les perspectives variées. Il en ressort un constat similaire à celui vu dernièrement au SIGGRAPH ou au Festival d’Annecy : celui d’une industrie en transition face à certaines évolutions. Les positions contrastées sur l’IA ont eu l’intérêt de mettre en lumière de multiples enjeux, à défaut d’apporter des réponses définitives.

En attendant, l’industrie célèbre aussi son histoire : entre anecdotes et jalons historiques, l’industrie transmet sa passion. Et la VIEW Conference s’affirme, avec un quart de siècle d’existence, comme un événement qui mérite le détour.